El hub de América Latina y el Caribe de la red f<a+i>r recibió el último día 29 de marzo a Milagros Miceli, investigadora en el Instituto Weizenbaum y en el Instituto DAIR.

Por Emilio Botello Oliva *

Como parte de las actividades llevadas a cabo por el hub de América Latina y el Caribe de la red fair de investigación feminista en inteligencia artificial, el 29 de marzo se realizó un conversatorio en línea con la investigadora participante de la red Milagros Miceli. Miceli dirige el grupo de investigación Datos, Sistemas Algorítmicos y Ética en el Weizenbaum-Institut y también trabaja como investigadora en el Instituto DAIR, en donde reflexiona sobre las formas de implicar a las comunidades de trabajadores de datos en la investigación de la IA. Es co-autora de trabajos como “How Data Can Be Used Against People: A Classification of Personal Data Misuses” (2021) y The Exploited Labor Behind Artificial Intelligence (2023).

En el conversatorio “Poder y sesgos en el trabajo de datos”, Miceli intercambió sobre el tema con base en su experiencia en el área de recolección de datos y detección de sesgos desde una perspectiva feminista crítica con integrantes y becarixs de la red de Argentina, Brasil y México. Su planteamiento se enfocó en recalcar que la inteligencia artificial (IA) es una herramienta poderosa, pero siempre hay y habrá personas detrás de su creación y uso.

Los datos del mundo real, también conocidos como Ground Truth Data, son la fuente de información crítica en la era de la inteligencia artificial. Sin embargo, los datos están influenciados por los sesgos o bias de aquellos que están a cargo de su recopilación y análisis. Siendo la única socióloga dentro del equipo de trabajo de ciencias de datos en el que laboró, Miceli notó que se estudiaba a la IA y a los datos que contenía como objetos y artefactos sin centrarse en el elemento humano. Así, planteó que la ética de la IA debe considerar también el trabajo que hay detrás para comprender adecuadamente su aplicación. Refiriéndose a lo mencionado por directora del laboratorio Data+Feminism del MIT, Catherine D’Ignazio, y la directora del Laboratorio de Humanidades Digitales en la Universidad de Emory (Atlanta, GA) Lauren F. Klein, en su libro Data Feminism (2020), recordó que “el dato es producto de relaciones sociales desiguales”.

En ese contexto, para comprender la importancia de los datos en el contexto de la IA, era necesario considerar qué son los datos y cómo se obtienen, además de conocer qué labores realizaba el trabajo de datos y en qué condiciones socioculturales se desarrolla. “La AI no es solo una caja negra”, como menciona Miceli, los datos sin procesar no son un hecho indiscutible y sus distorsiones pueden afectar el rendimiento del modelo. Por tanto, los datos no deben ser considerados como una verdad absoluta, sino como alguna verdad que puede existir en otra realidad, a pesar de que las ciencias duras asuman lo contrario.

Así, Miceli argumentó que es importante reconocer que los datos contienen los valores de aquellos que están a cargo de ellos y que esos valores influyen en cómo se clasifican y etiquetan las cosas. Las cuestiones de poder se hacen más visibles cuando se analizan los datos, por eso es importante cuestionar cómo se recopilan y se utilizan. En suma, los datos para sistemas son políticos porque reflejan asimetrías de poder, y por lo tal deben ser cuestionados. En última instancia, es responsabilidad del PI o de aquellos a cargo de los datos tomar decisiones informadas y éticas sobre su uso.

La mano de obra explotada detrás de la Inteligencia Artificial

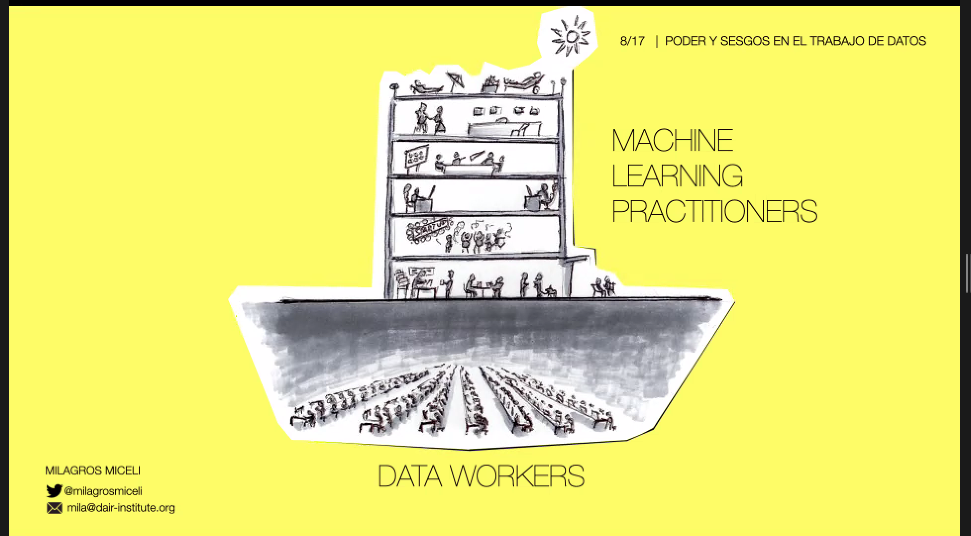

Extracto de la presentación de Milagros Miceli. (Captura de pantalla)

Mientras el público se distrae con el espectro de máquinas sintientes inexistentes, un ejército de trabajadores precarizados está detrás de los supuestos logros de los sistemas de inteligencia artificial actuales. Williams, Miceli y Gebru (2021)

Por otro lado, Miceli mencionó que gran parte del trabajo de datos trata de la selección y clasificación de para apoyar procesos de machine learning. Para que la computadora pueda “aprender” de los datos, necesita un entrenamiento inicial a partir del criterio humano. En ese contexto, la mayoría de los datos no se procesan en la sede de la empresa que los utilizará o en sus oficinas, sino de forma tercerizada través de otras plataformas o empresas (BPO). Se suele recurrir a trabajadores de regiones subdesarrolladas y de sectores vulnerables, como refugiados, personas de bajos recursos y con experiencia laboral nula, quienes son los encargados de producir estas bases de datos. Resulta más económico para las empresas, pero se basa en condiciones laborales precarias y mal remuneradas, sin protecciones ni seguridad laboral, aunque sin la colaboración de estos trabajadores, sería imposible llevar a cabo el trabajo de datos.

Miceli comentó que los sesgos hegemónicos derivan en la alienación, ya que no se les permite a lxs trabajadorxs a pensar por sí mismos. Se basa en la automatización y en la mentalidad de pensar como máquinas, limitándose a imitar a la IA. Existe la dificultad de ubicarse a si mismxs en relación a otrxs trabajadorxs, dificultando su posibilidad de ubicarse en la cadena productiva, en su rol dentro de un todo.

Finalmente, las alternativas a los modelos de negocio y participación deben ir más allá de cuestionar su efectividad y funcionamiento. Es importante desafiar el sistema de poder y replantear la necesidad de estos modelos. ¿Qué sucedería si interpretáramos los datos de acuerdo a nuestras percepciones y contextos culturales específicos?, de esta forma, se podría mejorar su aplicabilidad. En cuanto a los lugares de acción, es crucial luchar por salarios fijos y trabajadoras estables, decidir con qué materiales se desea trabajar, boicotear a empleadores con condiciones laborales precarias y conocer las condiciones locales para mejorar desde la base. Es necesario desmantelar los sistemas actuales para lograr una mejora significativa.

* Estudiante del 2° semestre de Ingeniería Mecánica y becario del LAC Hub de f<a+i>r en el Tecnológico de Monterrey.